اظهارات آلتمن: رباتها حس «جعلی» به شبکههای اجتماعی میدهند

سم آلتمن، از طرفداران X و سهامدار Reddit، روز دوشنبه به یک کشف مهم رسید: رباتها تشخیص اینکه آیا پستهای رسانههای اجتماعی واقعاً توسط انسانها نوشته شدهاند را غیرممکن کردهاند. او این مطلب را در پستی اعلام کرد.

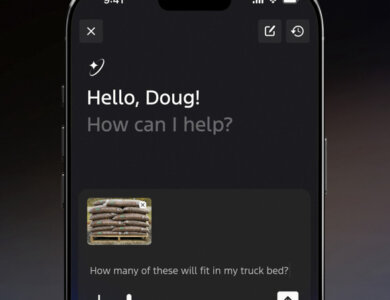

این درک در حین خواندن (و به اشتراک گذاشتن) برخی از پستهای سابردیت r/Claudecode به دست آمد که از OpenAI Codex تمجید میکردند. OpenAI سرویس برنامهنویسی نرمافزاری را راهاندازی کرد که در اردیبهشت ماه، رقیب Claude Code از Anthropic شد.

اخیراً، این سابردیت آنقدر پر از پستهایی از کاربران خودخوانده Code بوده که اعلام کردهاند به Codex مهاجرت کردهاند که یکی از کاربران Reddit حتی شوخی کرده است: “آیا امکان دارد بدون ارسال یک موضوع در Reddit به Codex تغییر وضعیت داد؟”

این موضوع باعث شد آلتمن تعجب کند که چه تعداد از این پستها از انسانهای واقعی هستند. او در X اعتراف کرد: “من عجیبترین تجربه را در خواندن اینها داشتهام: من فرض میکنم همه جعلی/ربات هستند، حتی اگر در این مورد بدانم که رشد Codex واقعاً قوی است و این روند واقعی است.”

او سپس استدلال خود را به صورت زنده تحلیل کرد. “من فکر میکنم مجموعهای از اتفاقات در حال رخ دادن است: افراد واقعی ویژگیهای گفتار مدلهای زبانی بزرگ (LLM) را تقلید میکنند، جمعیت آنلاین به شدت با هم مرتبط هستند، چرخه تبلیغات اغراقآمیز دارای افراط و تفریطی است (‘خیلی بد شد/دوباره برگشتیم’)، فشار بهینهسازی از سوی پلتفرمهای اجتماعی برای افزایش تعامل و نحوه کسب درآمد سازندگان محتوا، و اینکه شرکتهای دیگر ما را به صورت مصنوعی تبلیغ کردهاند، بنابراین من نسبت به آن حساستر هستم، و موارد بسیار دیگر (از جمله احتمالاً تعدادی ربات).”

برای رمزگشایی کمی از این موضوع، او انسانها را متهم میکند که شروع به شبیه شدن به LLMها کردهاند، حتی با اینکه LLMها – که OpenAI در راس آن قرار دارد – به معنای واقعی کلمه برای تقلید از ارتباطات انسانی اختراع شدهاند، دقیقاً مانند خط ربط. و مدلهای OpenAI قطعاً بر روی Reddit آموزش داده شدهاند، جایی که آلتمن تا سال ۱۴۰۱ عضو هیئت مدیره بود و در عرضه اولیه سهام شرکت در سال گذشته به عنوان سهامدار بزرگ معرفی شد.

او نکته درستی را مطرح میکند که طرفداران، به رهبری کاربران رسانههای اجتماعی که همیشه آنلاین هستند، تمایل دارند به روشهای عجیبی رفتار کنند. بسیاری از گروهها میتوانند به کانون نفرت تبدیل شوند اگر توسط کسانی که ناامیدیهای خود را برای برادرانشان تخلیه میکنند، تسخیر شوند.

سم همچنین انگیزههایی را که سایتهای رسانههای اجتماعی و سازندگان محتوا برای کسب درآمد به تعامل متکی هستند، مورد انتقاد قرار میدهد. منصفانه است.

اما سپس آلتمن اعتراف میکند که یکی از دلایلی که فکر میکند پستهای طرفدار OpenAI در این سابردیت ممکن است ربات باشند، این است که OpenAI نیز به صورت “مصنوعی تبلیغ شده” است. این معمولاً شامل پستهایی از افراد یا رباتهایی است که توسط رقیب یا پیمانکار درجه سوم پرداخت شدهاند و به رقیب امکان انکار منطقی میدهند.

ما هیچ مدرکی دال بر تبلیغات مصنوعی نداریم (اگرچه ممکن است). اما دیدیم که چگونه سابردیتهای OpenAI پس از انتشار GPT 5.0 علیه این شرکت موضع گرفتند. به جای موجی از تمجید از مدل جدید، بسیاری از پستهای خشمگین رای بالایی دریافت کردند. مردم به Reddit و X رفتند تا از همه چیز، از شخصیت GPT گرفته تا نحوه سوزاندن اعتبارات بدون اتمام وظایف، شکایت کنند.

یک روز پس از انتشار ناموفق، آلتمن یک جلسه پرسش و پاسخ در Reddit در r/GPT برگزار کرد که در آن به مشکلات انتشار اعتراف کرد و قول تغییر داد. سابردیت GPT هرگز به طور کامل سطح عشق قبلی خود را به دست نیاورد و کاربران همچنان به طور مرتب درباره میزان نارضایتی خود از تغییرات GPT 5.0 پست میگذارند. آیا آنها انسان هستند؟ یا همانطور که آلتمن به نظر میرسد، به نوعی جعلی هستند؟

آلتمن حدس میزند: “نتیجه نهایی این است که به نوعی توییتر/ردیت هوش مصنوعی به شکلی بسیار جعلی به نظر میرسد که یک یا دو سال پیش اینطور نبود.”

اگر این درست باشد، تقصیر کیست؟ GPT باعث شده مدلها در نوشتن آنقدر خوب شوند که LLMها نه تنها به سایتهای رسانههای اجتماعی (که همیشه مشکل ربات داشتهاند)، بلکه به مدارس، روزنامهنگاری و دادگاهها نیز آسیب رساندهاند.

در حالی که ما نمیدانیم چه تعداد از پستهای Reddit توسط رباتها نوشته شدهاند یا حسابهای داستانی توسط انسانها با استفاده از LLMها هستند، احتمالاً تعداد قابل توجهی از آنها اینگونهاند. شرکت امنیت داده Imperva گزارش داد که بیش از نیمی از کل ترافیک اینترنت در سال ۱۴۰۳ غیرانسانی بوده است که عمدتاً به دلیل LLMها بوده است. ربات Grok متعلق به X میگوید: “اعداد دقیق عمومی نیستند، اما تخمینهای سال ۱۴۰۳ نشان میدهد صدها میلیون ربات در X وجود دارد.”

چندین بدبین پیشنهاد کردهاند که ابراز تاسف آلتمن اولین تلاش او برای بازاریابی پلتفرم رسانههای اجتماعی شایعه شده OpenAI بوده است. در فروردین ماه، The Verge گزارش داد که چنین پروژهای برای رقابت با X و فیسبوک در مراحل اولیه قرار دارد. این محصول ممکن است وجود داشته باشد یا نباشد. ممکن است آلتمن انگیزههای پنهانی برای پیشنهاد اینکه رسانههای اجتماعی این روزها خیلی جعلی هستند، داشته باشد یا نداشته باشد.

اما فارغ از انگیزهها، اگر OpenAI در حال برنامهریزی یک شبکه اجتماعی است، چقدر احتمال دارد که یک منطقه عاری از ربات باشد؟ و جالب اینجاست که اگر برعکس عمل کند و انسانها را ممنوع کند، نتایج احتمالاً متفاوت نخواهد بود. نه تنها LLMها هنوز هم حقایق را توهم میزنند، بلکه زمانی که محققان دانشگاه آمستردام یک شبکه اجتماعی را که کاملاً از رباتها تشکیل شده بود، ساختند، دریافتند که رباتها به زودی برای خودشان گروهها و اتاقهای پژواک تشکیل میدهند.

منبع : techcrunch.com