انتخاب با کاربران Anthropic: حفظ حریم خصوصی یا مشارکت در آموزش هوش مصنوعی

شرکت آنتروپیک (Anthropic) در حال ایجاد تغییرات بزرگی در نحوه مدیریت دادههای کاربران است و از تمام کاربران کلود (Claude) میخواهد تا تاریخ ۶ مهر تصمیم بگیرند که آیا میخواهند مکالمات آنها برای آموزش مدلهای هوش مصنوعی استفاده شود یا خیر. در حالی که این شرکت ما را به پست وبلاگ خود در مورد تغییرات سیاستها ارجاع داد، ما نظریههای خود را در این باره شکل دادهایم.

اما اول، چه چیزی در حال تغییر است: قبلاً، آنتروپیک از دادههای چت مصرفکنندگان برای آموزش مدل استفاده نمیکرد. اکنون، این شرکت میخواهد سیستمهای هوش مصنوعی خود را بر اساس مکالمات کاربران و جلسات کدنویسی آموزش دهد و گفته است که مدت نگهداری دادهها را برای کسانی که انصراف ندهند، به پنج سال افزایش میدهد.

این یک بهروزرسانی بزرگ است. قبلاً، به کاربران محصولات مصرفی آنتروپیک گفته شده بود که اعلانها و خروجیهای مکالمه آنها به طور خودکار از قسمت پشتیبان آنتروپیک ظرف ۳۰ روز حذف میشوند “مگر اینکه از نظر قانونی یا سیاستی لازم باشد که برای مدت طولانیتری نگهداری شوند” یا ورودی آنها به عنوان نقض سیاستهای آن علامتگذاری شود، در این صورت ورودیها و خروجیهای کاربر ممکن است تا دو سال نگهداری شوند.

منظور از مصرفکننده، این است که سیاستهای جدید برای کاربران کلود رایگان، پرو و مکس، از جمله کسانی که از کلود کد استفاده میکنند، اعمال میشود. مشتریان تجاری که از کلود گاو، کلود برای کار، کلود برای آموزش یا دسترسی به API استفاده میکنند، تحت تأثیر قرار نخواهند گرفت، همانطور که OpenAI به طور مشابه از مشتریان سازمانی در برابر سیاستهای آموزش داده محافظت میکند.

پس چرا این اتفاق میافتد؟ آنتروپیک در آن پست درباره بهروزرسانی، تغییرات را حول محور انتخاب کاربر بیان میکند و میگوید با عدم انصراف، کاربران “به ما کمک میکنند ایمنی مدل را بهبود بخشیم، سیستمهای خود را برای شناسایی محتوای مضر دقیقتر کنیم و احتمال علامتگذاری مکالمات بیضرر را کاهش دهیم.” کاربران “همچنین به مدلهای کلود آینده کمک میکنند تا مهارتهایی مانند کدنویسی، تجزیه و تحلیل و استدلال را بهبود بخشند و در نهایت منجر به مدلهای بهتری برای همه کاربران شوند.”

به طور خلاصه، به ما کمک کنید به شما کمک کنیم. اما تمام حقیقت احتمالاً کمی کمتر فداکارانه است.

مانند هر شرکت بزرگ مدل زبانی دیگر، آنتروپیک به دادهها بیشتر از احساسات خوب مردم نسبت به برند خود نیاز دارد. آموزش مدلهای هوش مصنوعی به مقادیر زیادی داده مکالمه با کیفیت بالا نیاز دارد و دسترسی به میلیونها تعامل کلود باید دقیقاً همان نوع محتوای دنیای واقعی را ارائه دهد که میتواند موقعیت رقابتی آنتروپیک را در برابر رقبایی مانند OpenAI و گوگل بهبود بخشد.

فراتر از فشارهای رقابتی توسعه هوش مصنوعی، به نظر میرسد این تغییرات منعکس کننده تغییرات گستردهتر صنعت در سیاستهای داده نیز باشد، زیرا شرکتهایی مانند آنتروپیک و OpenAI با بررسی فزایندهای بر روی شیوههای نگهداری دادههای خود مواجه هستند. به عنوان مثال، OpenAI در حال حاضر در حال مبارزه با دستور دادگاهی است که این شرکت را مجبور میکند تمام مکالمات مصرفکننده ChatGPT را به طور نامحدود، از جمله چتهای حذف شده، به دلیل شکایت نیویورک تایمز و سایر ناشران حفظ کند.

در خرداد ماه، برد لایتکپ، مدیر ارشد عملیات OpenAI، این را “یک درخواست گسترده و غیرضروری” خواند که “اساساً با تعهدات حفظ حریم خصوصی که به کاربران خود دادهایم، مغایرت دارد.” دستور دادگاه بر کاربران ChatGPT رایگان، پلاس، پرو و تیم تأثیر میگذارد، اگرچه مشتریان سازمانی و کسانی که توافقنامههای عدم نگهداری داده دارند، همچنان محافظت میشوند.

آنچه نگران کننده است این است که چقدر سردرگمی همه این سیاستهای کاربری در حال تغییر برای کاربران ایجاد میکند، که بسیاری از آنها از این موضوع بیاطلاع هستند.

منصفانه بگوییم، همه چیز اکنون به سرعت در حال حرکت است، بنابراین با تغییر فناوری، سیاستهای حفظ حریم خصوصی نیز تغییر میکنند. اما بسیاری از این تغییرات کاملاً گسترده هستند و فقط به طور گذرا در میان سایر اخبار شرکتها ذکر میشوند. (با توجه به جایی که شرکت این بهروزرسانی را در صفحه مطبوعاتی خود قرار داده است، فکر نمیکنید تغییرات سیاستی روز سهشنبه برای کاربران آنتروپیک خبر بسیار بزرگی باشد.)

اما بسیاری از کاربران متوجه نمیشوند که دستورالعملهایی که با آنها موافقت کردهاند تغییر کرده است، زیرا طراحی عملاً آن را تضمین میکند. اکثر کاربران ChatGPT به کلیک کردن روی ضامنهای “حذف” ادامه میدهند که از نظر فنی هیچ چیزی را حذف نمیکنند. در همین حال، اجرای سیاست جدید آنتروپیک از یک الگوی آشنا پیروی میکند.

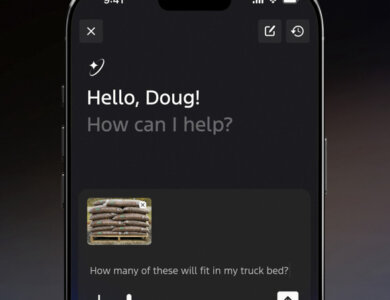

چطور؟ کاربران جدید در هنگام ثبتنام ترجیح خود را انتخاب میکنند، اما کاربران موجود با یک پنجره بازشو با “بهروزرسانی شرایط و سیاستهای مصرفکننده” با متن بزرگ و یک دکمه سیاه برجسته “پذیرش” با یک ضامن بسیار کوچکتر برای مجوزهای آموزش در زیر با حروف کوچکتر مواجه میشوند – و به طور خودکار روی “روشن” تنظیم شده است.

همانطور که قبلاً توسط The Verge مشاهده شد، این طراحی نگرانیهایی را ایجاد میکند مبنی بر اینکه کاربران ممکن است به سرعت روی “پذیرش” کلیک کنند بدون اینکه متوجه شوند که با اشتراکگذاری دادهها موافقت میکنند.

در همین حال، خطرات آگاهی کاربر نمیتواند بالاتر باشد. کارشناسان حفظ حریم خصوصی مدتهاست هشدار دادهاند که پیچیدگی پیرامون هوش مصنوعی، رضایت معنادار کاربر را تقریباً غیرممکن میکند. تحت دولت بایدن، کمیسیون تجارت فدرال (FTC) حتی وارد عمل شد و هشدار داد که شرکتهای هوش مصنوعی در صورت “تغییر پنهانی شرایط خدمات یا سیاست حفظ حریم خصوصی خود، یا پنهان کردن افشاگری در پشت پیوندها، در زبان حقوقی یا در حروف ریز” در معرض خطر اقدامات اجرایی قرار دارند.

اینکه آیا کمیسیون – که اکنون تنها با سه نفر از پنج کمیسر خود فعالیت میکند – هنوز امروز به این شیوهها توجه دارد یا خیر، یک سوال باز است، سوالی که مستقیماً از FTC پرسیدهایم.

منبع: techcrunch.com