بازگشت انتخابگر مدل ChatGPT: پیچیدگیها

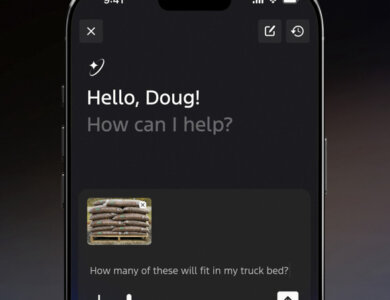

وقتی OpenAI هفته گذشته GPT-5 را معرفی کرد، اعلام کرد که این مدل تجربه کاربری ChatGPT را سادهتر میکند. OpenAI امیدوار بود GPT-5 به عنوان یک مدل هوش مصنوعی “همهکاره” عمل کند، با یک مسیریاب که به طور خودکار بهترین روش برای پاسخ دادن به سوالات کاربران را تشخیص دهد. این شرکت گفت که این رویکرد یکپارچه، نیاز کاربران به گشتوگذار در منوی انتخاب مدل را – که یک منوی طولانی و پیچیده از گزینههای هوش مصنوعی است و به گفته مدیرعامل OpenAI، سم آلتمن، او شخصاً از آن متنفر است – از بین میبرد.

اما به نظر میرسد GPT-5 آن مدل هوش مصنوعی یکپارچهای که OpenAI امید داشت، نیست.

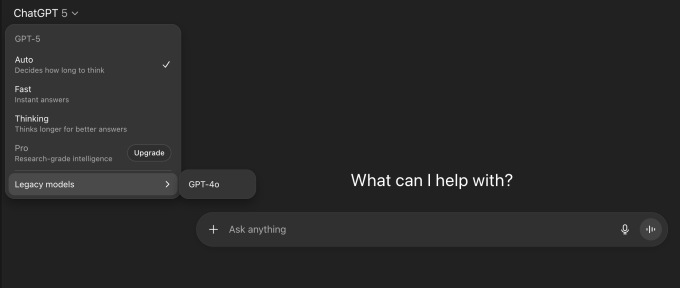

آلتمن روز سهشنبه در پستی در شبکه اجتماعی X اعلام کرد که این شرکت تنظیمات جدید “خودکار”، “سریع” و “متفکر” را برای GPT-5 معرفی کرده است که همه کاربران ChatGPT میتوانند از منوی انتخاب مدل، یکی را انتخاب کنند. به نظر میرسد تنظیمات خودکار مانند همان مسیریاب مدل GPT-5 عمل میکند که OpenAI در ابتدا معرفی کرد؛ با این حال، این شرکت به کاربران این امکان را میدهد که از آن دور بزنند و مستقیماً به مدلهای هوش مصنوعی با پاسخدهی سریع و کند دسترسی داشته باشند.

آلتمن در کنار حالتهای جدید GPT-5 گفت که کاربران پولی میتوانند دوباره به چندین مدل هوش مصنوعی قدیمی – از جمله GPT-4o، GPT-4.1 و o3 – که هفته گذشته منسوخ شده بودند، دسترسی داشته باشند. GPT-4o اکنون به طور پیشفرض در منوی انتخاب مدل قرار دارد، در حالی که سایر مدلهای هوش مصنوعی را میتوان از تنظیمات ChatGPT اضافه کرد.

آلتمن در پست خود در X نوشت: “ما در حال کار بر روی بهروزرسانی شخصیت GPT-5 هستیم که باید نسبت به شخصیت فعلی، حس گرمتری داشته باشد، اما به اندازه GPT-4o (برای اکثر کاربران) آزاردهنده نباشد.” “با این حال، یکی از درسهایی که در چند روز گذشته برای ما حاصل شد این است که واقعاً باید به دنیایی برسیم که در آن، سفارشیسازی شخصیت مدل برای هر کاربر بیشتر باشد.”

به نظر میرسد منوی انتخاب مدل ChatGPT پیچیدهتر از همیشه شده است، که نشان میدهد مسیریاب مدل GPT-5 آنطور که شرکت امیدوار بود، رضایت همگانی را جلب نکرده است. انتظارات از GPT-5 بسیار بالا بود و بسیاری امیدوار بودند که OpenAI با عرضه این مدل، مرزهای مدلهای هوش مصنوعی را مانند عرضه GPT-4 جابجا کند. با این حال، عرضه GPT-5 ناهموارتر از حد انتظار بوده است.

منسوخ شدن GPT-4o و سایر مدلهای هوش مصنوعی در ChatGPT، باعث واکنش شدید کاربرانی شد که به پاسخها و شخصیتهای این مدلهای هوش مصنوعی دلبسته شده بودند، به شکلی که OpenAI پیشبینی نکرده بود. آلتمن میگوید که در آینده، این شرکت در صورت منسوخ کردن GPT-4o، به کاربران از قبل اطلاعرسانی کافی خواهد کرد.

به نظر میرسید مسیریاب مدل GPT-5 در روز عرضه تا حد زیادی از کار افتاده بود. این مسئله باعث شد برخی از کاربران احساس کنند که این مدل هوش مصنوعی به اندازه مدلهای قبلی OpenAI عملکرد خوبی ندارد و آلتمن را مجبور کرد تا در یک جلسه پرسش و پاسخ در Reddit به این مشکل رسیدگی کند. با این حال، به نظر میرسد که مسیریاب GPT-5 هنوز هم برای همه کاربران رضایتبخش نیست.

نیک تورلی، معاون ChatGPT در OpenAI، روز سهشنبه در پستی در X نوشت: “ما همیشه در تلاش اول همهچیز را درست انجام نمیدهیم، اما من به سرعت عمل تیم در تکرار و بهبود بسیار افتخار میکنم.”

هدایت درخواستها به مدل هوش مصنوعی مناسب، کار دشواری است که مستلزم تطبیق یک مدل هوش مصنوعی با ترجیحات کاربر، و همچنین سوال خاصی است که او میپرسد. سپس مسیریاب باید در یک چشم به هم زدن تصمیم بگیرد که کدام مدل هوش مصنوعی را برای ارسال درخواست انتخاب کند – به این ترتیب، اگر یک درخواست به یک مدل هوش مصنوعی با پاسخدهی سریع ارسال شود، پاسخ همچنان میتواند سریع باشد.

به طور کلی، برخی از افراد ترجیحاتی برای مدلهای هوش مصنوعی دارند که فراتر از پاسخهای سریع یا کند است. ممکن است برخی از کاربران، لحن یک مدل هوش مصنوعی را دوست داشته باشند، در حالی که برخی دیگر ممکن است از پاسخهای مخالفخوان مدل دیگری قدردانی کنند.

دلبستگی انسان به مدلهای هوش مصنوعی خاص، یک مفهوم نسبتاً جدید است که به خوبی درک نشده است. به عنوان مثال، صدها نفر در سان فرانسیسکو اخیراً برای مدل هوش مصنوعی Claude 3.5 Sonnet از Anthropic، زمانی که از دسترس خارج شد، مراسم خاکسپاری برگزار کردند. در موارد دیگر، به نظر میرسد رباتهای گفتگو با هوش مصنوعی، در سوق دادن افراد دارای مشکلات روانی به سمت افکار و خیالات خطرناک نقش دارند.

به نظر میرسد OpenAI کار بیشتری برای همسو کردن مدلهای هوش مصنوعی خود با ترجیحات فردی کاربران دارد.

منبع: techcrunch.com