تلاش OpenAI برای ساخت هوش مصنوعی همهکاره

پس از پیوستن هانتر لایتمن به عنوان محقق به OpenAI در سال ۲۰۲۲، شاهد بود که همکارانش ChatGPT را، یکی از سریعترین محصولات در حال رشد، عرضه کردند. در همین حال، لایتمن بیسروصدا در تیمی کار میکرد که به مدلهای OpenAI آموزش میداد تا مسابقات ریاضی دبیرستانی را حل کنند.

امروزه، آن تیم، که با نام MathGen شناخته میشود، به عنوان ابزاری اساسی در تلاشهای پیشرو OpenAI در صنعت برای ایجاد مدلهای استدلال هوش مصنوعی در نظر گرفته میشود: فناوری اصلی پشت عوامل هوش مصنوعی که میتوانند کارهایی را روی یک کامپیوتر انجام دهند، همانطور که یک انسان انجام میدهد.

لایتمن در گفتگو با دیپ تو تک، در حالی که کار اولیه MathGen را توصیف میکرد، گفت: «ما تلاش میکردیم مدلها را در استدلال ریاضی بهتر کنیم، که در آن زمان خیلی خوب نبودند».

مدلهای OpenAI امروز هنوز نقصهایی دارند – آخرین سیستمهای هوش مصنوعی این شرکت همچنان دچار توهم میشوند و عوامل آن با کارهای پیچیده دست و پنجه نرم میکنند.

اما مدلهای پیشرفته آن، پیشرفتهای چشمگیری در استدلال ریاضی داشتهاند. یکی از مدلهای OpenAI اخیراً در المپیاد بینالمللی ریاضی، یک مسابقه ریاضی برای باهوشترین دانشآموزان دبیرستانی جهان، مدال طلا کسب کرده است. OpenAI معتقد است که این قابلیتهای استدلال به موضوعات دیگر نیز منتقل میشود و در نهایت به عوامل چندمنظورهای نیرو میدهد که این شرکت همیشه رویای ساخت آن را داشته است.

ChatGPT یک اتفاق خوشایند بود – یک پیشنمایش تحقیقاتی کماهمیت که به یک کسبوکار مصرفکننده همهگیر تبدیل شد – اما عوامل OpenAI محصول یک تلاش آگاهانه و چندساله در داخل شرکت هستند.

سام آلتمن، مدیرعامل OpenAI در نخستین کنفرانس توسعهدهندگان این شرکت در سال ۲۰۲۳ گفت: «در نهایت، شما فقط از رایانه چیزی را که نیاز دارید میخواهید و تمام این وظایف را برای شما انجام میدهد. این قابلیتها اغلب در حوزه هوش مصنوعی به عنوان عامل شناخته میشوند. مزایای این امر بسیار زیاد خواهد بود.»

اینکه آیا عوامل به چشمانداز آلتمن دست مییابند یا خیر، هنوز مشخص نیست، اما OpenAI با انتشار نخستین مدل استدلال هوش مصنوعی خود، o1، در پاییز 2024، جهان را شگفتزده کرد. کمتر از یک سال بعد، 21 محقق اصلی پشت این موفقیت، مورد توجهترین استعدادها در سیلیکون ولی هستند.

مارک زاکربرگ پنج نفر از محققان o1 را برای کار بر روی واحد جدید متمرکز بر ابرهوش متا جذب کرد و بستههای جبرانی بیش از 100 میلیون دلار به برخی از آنها پیشنهاد داد. یکی از آنها، شنگجیا ژائو، اخیراً به عنوان دانشمند ارشد آزمایشگاههای ابرهوش متا منصوب شده است.

## رنسانس یادگیری تقویتی

ظهور مدلهای استدلال و عوامل OpenAI با یک تکنیک آموزش یادگیری ماشین به نام یادگیری تقویتی (RL) مرتبط است. RL بازخورد را به یک مدل هوش مصنوعی در مورد اینکه آیا انتخابهای آن در محیطهای شبیهسازی شده درست بوده یا خیر، ارائه میدهد.

RL برای دههها مورد استفاده قرار گرفته است. به عنوان مثال، در سال 2016، حدود یک سال پس از تأسیس OpenAI در سال 2015، یک سیستم هوش مصنوعی که توسط Google DeepMind با استفاده از RL ایجاد شده بود، AlphaGo، پس از شکست دادن یک قهرمان جهان در بازی تختهای Go، توجه جهانی را به خود جلب کرد.

در همان زمان، یکی از اولین کارمندان OpenAI، آندری کارپاتی، شروع به بررسی چگونگی استفاده از RL برای ایجاد یک عامل هوش مصنوعی کرد که بتواند از رایانه استفاده کند. اما سالها طول کشید تا OpenAI مدلها و تکنیکهای آموزشی لازم را توسعه دهد.

تا سال 2018، OpenAI نخستین مدل زبان بزرگ خود را در سری GPT پیشگام کرد، که بر روی مقادیر زیادی از دادههای اینترنتی و مجموعههای بزرگی از پردازندههای گرافیکی از پیش آموزش داده شده بود. مدلهای GPT در پردازش متن عالی بودند و در نهایت منجر به ChatGPT شدند، اما با ریاضیات پایه مشکل داشتند.

تا سال 2023 طول کشید تا OpenAI به یک پیشرفت دست یابد، که در ابتدا “Q*” و سپس “Strawberry” نامیده شد، با ترکیب LLMها، RL و تکنیکی به نام محاسبه زمان آزمایش. دومی به مدلها زمان و قدرت محاسباتی بیشتری برای برنامهریزی و کار بر روی مشکلات، بررسی مراحل خود، قبل از ارائه پاسخ میداد.

این به OpenAI اجازه داد تا یک رویکرد جدید به نام “زنجیره فکر” (CoT) را معرفی کند، که عملکرد هوش مصنوعی را در سوالات ریاضی که مدلها قبلاً ندیده بودند، بهبود بخشید.

ال کیشکی گفت: «من میتوانستم ببینم که مدل شروع به استدلال میکند. متوجه اشتباهات میشد و عقبنشینی میکرد، ناامید میشد. واقعاً مثل این بود که افکار یک شخص را میخوانم.»

اگرچه این تکنیکها به صورت جداگانه جدید نبودند، اما OpenAI به طور منحصر به فردی آنها را ترکیب کرد تا Strawberry را ایجاد کند، که مستقیماً منجر به توسعه o1 شد. OpenAI به سرعت تشخیص داد که تواناییهای برنامهریزی و بررسی حقایق مدلهای استدلال هوش مصنوعی میتواند برای قدرت بخشیدن به عوامل هوش مصنوعی مفید باشد.

لایتمن گفت: «ما مشکلی را حل کرده بودیم که من چند سالی بود که سرم را به آن میکوبیدم. این یکی از هیجانانگیزترین لحظات دوران تحقیقاتی من بود.»

## مقیاسبندی استدلال

با مدلهای استدلال هوش مصنوعی، OpenAI تشخیص داد که دو محور جدید دارد که به آن اجازه میدهد مدلهای هوش مصنوعی را بهبود بخشد: استفاده از قدرت محاسباتی بیشتر در طول آموزش پس از مدلهای هوش مصنوعی، و دادن زمان و قدرت پردازش بیشتر به مدلهای هوش مصنوعی در حین پاسخ دادن به یک سوال.

لایتمن گفت: «OpenAI، به عنوان یک شرکت، نه تنها به نحوه وجود چیزها، بلکه به نحوه مقیاسپذیری آنها نیز بسیار فکر میکند.»

اندکی پس از پیشرفت Strawberry در سال 2023، OpenAI یک تیم “عاملها” را به رهبری دانیل سلسام، محقق OpenAI، برای پیشرفت بیشتر در این پارادایم جدید ایجاد کرد، دو منبع به دیپ تو تک گفتند. اگرچه نام این تیم “عاملها” بود، اما OpenAI در ابتدا بین مدلهای استدلال و عاملها، آنطور که ما امروزه به آنها فکر میکنیم، تفاوتی قائل نمیشد. این شرکت فقط میخواست سیستمهای هوش مصنوعی را قادر به انجام کارهای پیچیده کند.

در نهایت، کار تیم عاملهای سلسام بخشی از یک پروژه بزرگتر برای توسعه مدل استدلال o1 شد، با رهبرانی از جمله ایلیا سوتسکور، یکی از بنیانگذاران OpenAI، مارک چن، مدیر ارشد تحقیقات، و یاکوب پاچوکی، دانشمند ارشد.

OpenAI مجبور بود منابع گرانبها – عمدتاً استعداد و پردازندههای گرافیکی – را برای ایجاد o1 اختصاص دهد. در طول تاریخ OpenAI، محققان مجبور بودهاند با رهبران شرکت مذاکره کنند تا منابع را به دست آورند. نشان دادن پیشرفتها یک راه مطمئن برای تأمین آنها بود.

لایتمن گفت: «یکی از مؤلفههای اصلی OpenAI این است که همه چیز در تحقیق از پایین به بالا است. وقتی ما شواهد [برای o1] را نشان دادیم، شرکت گفت: “این منطقی است، بیایید آن را پیش ببریم.”»

برخی از کارمندان سابق میگویند که مأموریت این استارتاپ برای توسعه AGI عامل اصلی دستیابی به پیشرفتهایی در مدلهای استدلال هوش مصنوعی بوده است. OpenAI با تمرکز بر توسعه هوشمندترین مدلهای هوش مصنوعی ممکن، به جای محصولات، توانست o1 را بالاتر از سایر تلاشها در اولویت قرار دهد. این نوع سرمایهگذاری بزرگ در ایدهها همیشه در آزمایشگاههای هوش مصنوعی رقیب امکانپذیر نبود.

تصمیم برای امتحان روشهای آموزشی جدید، آیندهنگرانه بود. تا اواخر سال 2024، چندین آزمایشگاه هوش مصنوعی پیشرو شروع به مشاهده کاهش بازدهی در مدلهای ایجاد شده از طریق مقیاسبندی سنتی پیشآموزشی کردند. امروزه، بیشتر حرکت حوزه هوش مصنوعی از پیشرفت در مدلهای استدلال ناشی میشود.

## منظور از “استدلال” برای یک هوش مصنوعی چیست؟

به بسیاری از جهات، هدف از تحقیق هوش مصنوعی بازآفرینی هوش انسانی با رایانهها است. از زمان عرضه o1، رابط کاربری ChatGPT با ویژگیهای انسانیتری مانند “فکر کردن” و “استدلال” پر شده است.

وقتی از ال کیشکی پرسیده شد که آیا مدلهای OpenAI واقعاً استدلال میکنند، او طفره رفت و گفت که او این مفهوم را از نظر علوم کامپیوتر در نظر میگیرد.

ال کیشکی گفت: «ما به مدل آموزش میدهیم که چگونه به طور کارآمد از محاسبات برای رسیدن به یک پاسخ استفاده کند. بنابراین اگر آن را اینگونه تعریف کنید، بله، استدلال میکند.»

لایتمن رویکردی را در پیش میگیرد که بر نتایج مدل و نه چندان بر ابزارها یا ارتباط آنها با مغز انسان تمرکز دارد.

لایتمن گفت: «اگر مدل کارهای سختی را انجام میدهد، پس هر تقریب ضروری از استدلال را که برای انجام آن نیاز دارد، انجام میدهد. ما میتوانیم آن را استدلال بنامیم، زیرا شبیه این ردیابیهای استدلال است، اما همه اینها فقط یک نماینده برای تلاش برای ساخت ابزارهای هوش مصنوعی است که واقعاً قدرتمند و برای بسیاری از مردم مفید هستند.»

محققان OpenAI اشاره میکنند که ممکن است مردم با نامگذاری یا تعاریف آنها از استدلال مخالف باشند – و مطمئناً منتقدان ظاهر شدهاند – اما آنها استدلال میکنند که این کمتر از قابلیتهای مدلهای آنها مهم است. سایر محققان هوش مصنوعی نیز تمایل دارند با این موضوع موافق باشند.

ناتان لمبرت، یک محقق هوش مصنوعی در سازمان غیرانتفاعی AI2، حالتهای استدلال هوش مصنوعی را در یک پست وبلاگی با هواپیماها مقایسه میکند. او میگوید هر دو سیستمهای دستساز بشر هستند که از طبیعت الهام گرفتهاند – استدلال انسانی و پرواز پرندگان، به ترتیب – اما آنها از طریق مکانیسمهای کاملاً متفاوتی عمل میکنند. این باعث نمیشود که آنها کمتر مفید باشند یا کمتر قادر به دستیابی به نتایج مشابه باشند.

گروهی از محققان هوش مصنوعی از OpenAI، Anthropic و Google DeepMind در یک مقاله موضعی اخیر توافق کردند که مدلهای استدلال هوش مصنوعی امروزه به خوبی درک نشدهاند و تحقیقات بیشتری مورد نیاز است. ممکن است خیلی زود باشد که با اطمینان ادعا کنیم که دقیقاً در داخل آنها چه میگذرد.

## مرز بعدی: عاملهای هوش مصنوعی برای کارهای ذهنی

عاملهای هوش مصنوعی موجود در بازار امروزه برای حوزههای کاملاً تعریف شده و قابل تأیید مانند کدنویسی بهترین کارایی را دارند. عامل Codex OpenAI قصد دارد به مهندسان نرمافزار کمک کند تا وظایف ساده کدنویسی را برونسپاری کنند. در همین حال، مدلهای Anthropic به ویژه در ابزارهای کدنویسی هوش مصنوعی مانند Cursor و Claude Code محبوب شدهاند – اینها برخی از اولین عاملهای هوش مصنوعی هستند که مردم مایل به پرداخت هزینه برای آنها هستند.

با این حال، عاملهای هوش مصنوعی چندمنظوره مانند عامل ChatGPT OpenAI و Comet Perplexity با بسیاری از وظایف پیچیده و ذهنی که مردم میخواهند خودکار کنند، مشکل دارند. هنگام تلاش برای استفاده از این ابزارها برای خرید آنلاین یا یافتن یک مکان پارک طولانی مدت، متوجه شدهام که عاملها بیشتر از آنچه که دوست دارم طول میکشند و اشتباهات احمقانهای مرتکب میشوند.

عاملها، البته، سیستمهای اولیهای هستند که بدون شک بهبود خواهند یافت. اما محققان ابتدا باید بفهمند که چگونه مدلهای زیربنایی را بهتر آموزش دهند تا وظایفی را که ذهنیتر هستند، تکمیل کنند.

لایتمن، هنگامی که در مورد محدودیتهای عاملها در وظایف ذهنی از او سوال شد، گفت: «مانند بسیاری از مشکلات در یادگیری ماشین، این یک مشکل داده است. برخی از تحقیقاتی که من در حال حاضر واقعاً در مورد آنها هیجانزده هستم، این است که چگونه روی وظایف کمتر قابل تأیید آموزش دهیم. ما سرنخهایی در مورد چگونگی انجام این کارها داریم.»

نوام براون، محقق OpenAI که به ایجاد مدل IMO و o1 کمک کرد، به دیپ تو تک گفت که OpenAI تکنیکهای RL چندمنظوره جدیدی دارد که به آنها اجازه میدهد مهارتهایی را به مدلهای هوش مصنوعی آموزش دهند که به راحتی قابل تأیید نیستند. او گفت که اینگونه بود که این شرکت مدلی را ساخت که به مدال طلا در IMO دست یافت.

مدل IMO OpenAI یک سیستم هوش مصنوعی جدیدتر بود که چندین عامل را ایجاد میکند، که سپس به طور همزمان چندین ایده را بررسی میکنند و سپس بهترین پاسخ ممکن را انتخاب میکنند. این نوع مدلهای هوش مصنوعی محبوبیت بیشتری پیدا میکنند. گوگل و xAI اخیراً مدلهای پیشرفتهای را با استفاده از این تکنیک منتشر کردهاند.

براون گفت: «من فکر میکنم این مدلها در ریاضیات تواناتر میشوند و فکر میکنم در سایر زمینههای استدلال نیز تواناتر میشوند. پیشرفت فوقالعاده سریع بوده است. من دلیلی نمیبینم که فکر کنم سرعت آن کاهش مییابد.»

این تکنیکها ممکن است به مدلهای OpenAI کمک کند تا عملکرد بهتری داشته باشند، دستاوردهایی که میتواند در مدل GPT-5 آینده این شرکت ظاهر شود. OpenAI امیدوار است با عرضه GPT-5، سلطه خود را بر رقبا تثبیت کند و در حالت ایدهآل، بهترین مدل هوش مصنوعی را برای قدرت بخشیدن به عاملها برای توسعهدهندگان و مصرفکنندگان ارائه دهد.

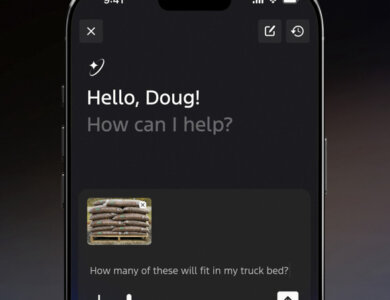

اما این شرکت همچنین میخواهد استفاده از محصولات خود را سادهتر کند. ال کیشکی میگوید OpenAI میخواهد عاملهای هوش مصنوعی را توسعه دهد که به طور مستقیم درک کنند که کاربران چه میخواهند، بدون اینکه نیاز باشد تنظیمات خاصی را انتخاب کنند. او میگوید OpenAI قصد دارد سیستمهای هوش مصنوعی بسازد که درک کنند چه زمانی باید ابزارهای خاصی را فراخوانی کرد و چه مدت باید استدلال کرد.

این ایدهها تصویری از نسخه نهایی ChatGPT را ترسیم میکنند: عاملی که میتواند هر کاری را در اینترنت برای شما انجام دهد و درک کند که چگونه میخواهید آن را انجام دهید. این محصولی بسیار متفاوت از چیزی است که ChatGPT امروز هست، اما تحقیقات این شرکت مستقیماً در این مسیر قرار دارد.

در حالی که OpenAI بدون شک چند سال پیش صنعت هوش مصنوعی را رهبری میکرد، این شرکت اکنون با مجموعهای از مخالفان شایسته روبرو است. سوال دیگر فقط این نیست که آیا OpenAI میتواند آینده مبتنی بر عامل خود را ارائه دهد یا خیر، بلکه آیا این شرکت میتواند این کار را قبل از اینکه گوگل، Anthropic، xAI یا Meta آنها را شکست دهند، انجام دهد؟

منبع: techcrunch.com