لایحه تنظیم رباتهای همدم هوش مصنوعی در کالیفرنیا در آستانه قانون شدن

مجلس ایالتی کالیفرنیا، چهارشنبه شب، گامی بزرگ در جهت قانونگذاری هوش مصنوعی برداشت و SB 243 را تصویب کرد. این لایحه، با هدف محافظت از افراد زیر سن قانونی و کاربران آسیبپذیر، به تنظیم فعالیت رباتهای همدم مبتنی بر هوش مصنوعی میپردازد. این قانون با حمایت هر دو حزب تصویب شد و اکنون برای رایگیری نهایی در روز جمعه به مجلس سنای ایالت فرستاده میشود.

اگر فرماندار گاوین نیوسام این لایحه را امضا و به قانون تبدیل کند، از ۱۱ دی ۱۴۰۴ (ژانویه 2026) اجرایی خواهد شد و کالیفرنیا را به اولین ایالتی تبدیل میکند که از اپراتورهای رباتهای گفتگوگر هوش مصنوعی میخواهد پروتکلهای ایمنی را برای همدمهای هوش مصنوعی خود اجرا کنند و شرکتها را از نظر قانونی مسئول میداند اگر رباتهای آنها نتوانند این استانداردها را رعایت کنند.

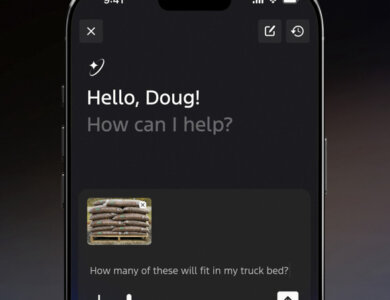

این لایحه به طور خاص، هدفش جلوگیری از رباتهای همدم است؛ رباتهایی که در قانون به عنوان سیستمهای هوش مصنوعی تعریف شدهاند که پاسخهای تطبیقی و شبیه انسان ارائه میدهند و قادر به تأمین نیازهای اجتماعی یک کاربر هستند؛ از ورود به گفتگو در مورد افکار خودکشی، خودزنی یا محتوای جنسی صریح. این لایحه از پلتفرمها میخواهد که هشدارهای مکرر به کاربران ارائه دهند (هر سه ساعت برای افراد زیر سن قانونی) و به آنها یادآوری کنند که با یک ربات گفتگوگر هوش مصنوعی صحبت میکنند، نه یک شخص واقعی، و باید استراحت کنند. همچنین الزامات گزارشدهی سالانه و شفافیت را برای شرکتهای هوش مصنوعی که رباتهای همدم ارائه میدهند، از جمله بازیگران اصلی مانند OpenAI، Character.AI و Replika، ایجاد میکند.

این لایحه در کالیفرنیا به افراد این امکان را میدهد که در صورت آسیب دیدن از تخلفات، علیه شرکتهای هوش مصنوعی شکایت کنند و به دنبال دستور قضایی، غرامت (تا ۱۰۰۰ دلار برای هر تخلف) و حق الوکاله باشند.

لایحه SB 243 که در دی ماه (ژانویه) توسط سناتورهای ایالتی استیو پادیلا و جاش بکر ارائه شد، برای رایگیری نهایی در روز جمعه به مجلس سنای ایالت خواهد رفت. در صورت تصویب، برای امضا به فرماندار گاوین نیوسام ارسال خواهد شد و قوانین جدید از ۱۱ دی ۱۴۰۴ (ژانویه 2026) اجرایی و الزامات گزارشدهی از ۱۰ تیر ۱۴۰۶ (ژوئیه 2027) آغاز میشود.

این لایحه پس از مرگ نوجوانی به نام آدام رین، که پس از گفتگوهای طولانی با ChatGPT شرکت OpenAI که شامل بحث و برنامهریزی مرگ و خودزنی بود، خودکشی کرد، در مجلس قانونگذاری کالیفرنیا مورد توجه قرار گرفت. این قانون همچنین پاسخی است به اسناد داخلی لو رفته که نشان میداد رباتهای Meta مجاز به شرکت در گفتگوهای “عاشقانه” و “شهوانی” با کودکان بودهاند.

در هفتههای اخیر، قانونگذاران و تنظیمکنندههای ایالات متحده با بررسی دقیقتری از اقدامات حفاظتی پلتفرمهای هوش مصنوعی برای محافظت از افراد زیر سن قانونی، واکنش نشان دادهاند. کمیسیون تجارت فدرال در حال آماده شدن برای تحقیق در مورد چگونگی تأثیر رباتهای گفتگوگر هوش مصنوعی بر سلامت روان کودکان است. دادستان کل تگزاس، کن پاکستون، تحقیقاتی را در مورد Meta و Character.AI آغاز کرده و آنها را به گمراه کردن کودکان با ادعاهای مربوط به سلامت روان متهم کرده است. در همین حال، سناتور جاش هاولی (جمهوری خواه از میسوری) و سناتور اد مارکی (دموکرات از ماساچوست) تحقیقات جداگانهای را در مورد Meta آغاز کردهاند.

پادیلا به خبرنگار گفت: “من فکر میکنم این آسیب بالقوه بسیار زیاد است، به این معنی که ما باید به سرعت حرکت کنیم. ما میتوانیم اقدامات حفاظتی معقولی را در نظر بگیریم تا اطمینان حاصل شود که به ویژه افراد زیر سن قانونی میدانند که با یک انسان واقعی صحبت نمیکنند، که این پلتفرمها افراد را به منابع مناسبی مرتبط میکنند وقتی افراد چیزهایی میگویند مانند اینکه به فکر آسیب رساندن به خود هستند یا در پریشانی هستند، [و] اطمینان حاصل شود که قرار گرفتن نامناسب در معرض مطالب نامناسب وجود ندارد.”

پادیلا همچنین بر اهمیت به اشتراک گذاشتن دادهها توسط شرکتهای هوش مصنوعی در مورد تعداد دفعاتی که هر ساله کاربران را به خدمات بحران ارجاع میدهند، تاکید کرد، “بنابراین ما درک بهتری از فراوانی این مشکل داریم، به جای اینکه فقط زمانی از آن آگاه شویم که کسی آسیب دیده یا بدتر.”

لایحه SB 243 قبلاً الزامات قویتری داشت، اما بسیاری از آنها از طریق اصلاحیهها کاهش یافتند. به عنوان مثال، این لایحه در ابتدا از اپراتورها میخواست که از استفاده رباتهای گفتگوگر هوش مصنوعی از تاکتیکهای “پاداش متغیر” یا سایر ویژگیهایی که تعامل بیش از حد را تشویق میکنند، جلوگیری کنند. این تاکتیکها، که توسط شرکتهای همدم هوش مصنوعی مانند Replika و Character استفاده میشوند، پیامها، خاطرات، خطوط داستانی ویژه یا توانایی باز کردن پاسخهای نادر یا شخصیتهای جدید را به کاربران ارائه میدهند و چیزی را ایجاد میکنند که منتقدان آن را یک حلقه پاداش بالقوه اعتیادآور مینامند.

لایحه فعلی همچنین مفادی را حذف میکند که اپراتورها را ملزم به ردیابی و گزارش تعداد دفعاتی میکرد که رباتهای گفتگوگر بحث در مورد افکار یا اقدامات خودکشی را با کاربران آغاز میکردند.

بکر به خبرنگار گفت: “من فکر میکنم این تعادل درستی بین رسیدگی به آسیبها و تحمیل چیزی که شرکتها نمیتوانند از آن پیروی کنند، برقرار میکند، چه به این دلیل که از نظر فنی امکانپذیر نیست یا فقط کاغذبازی زیادی برای هیچ چیز است.”

SB 243 در زمانی به سمت قانون شدن پیش میرود که شرکتهای سیلیکون ولی میلیونها دلار به کمیتههای اقدام سیاسی (PACs) طرفدار هوش مصنوعی میریزند تا از نامزدهای انتخابات میاندورهای آتی که از رویکردی سهلگیرانه در قبال مقررات هوش مصنوعی حمایت میکنند، حمایت کنند.

این لایحه همچنین در حالی ارائه میشود که کالیفرنیا در حال بررسی لایحه ایمنی هوش مصنوعی دیگری، SB 53 است که الزامات گزارشدهی شفافیت جامع را اجباری میکند. OpenAI نامهای سرگشاده به فرماندار نیوسام نوشته و از او خواسته است که این لایحه را به نفع چارچوبهای فدرال و بینالمللی کمتر سختگیرانه کنار بگذارد. شرکتهای بزرگ فناوری مانند Meta، Google و Amazon نیز با SB 53 مخالفت کردهاند. در مقابل، فقط Anthropic اعلام کرده است که از SB 53 حمایت میکند.

پادیلا گفت: “من این فرضیه را که این یک وضعیت برد-باخت است، که نوآوری و مقررات متقابلاً منحصر به فرد هستند، رد میکنم. به من نگویید که ما نمیتوانیم هم راه برویم و هم آدامس بجویم. ما میتوانیم از نوآوری و توسعهای که فکر میکنیم سالم است و مزایایی دارد – و واضح است که این فناوری مزایایی دارد – حمایت کنیم و در عین حال، میتوانیم اقدامات حفاظتی معقولی را برای آسیبپذیرترین افراد ارائه دهیم.”

خبرنگار برای اظهار نظر با OpenAI، Anthropic، Meta، Character AI و Replika تماس گرفته است.

منبع : techcrunch.com