کارن هائو: امپراتوری هوش مصنوعی، مبلغان هوش مصنوعی عمومی و بهای اعتقاد

در قلب هر امپراتوری، یک ایدئولوژی وجود دارد، یک نظام باور که سیستم را به جلو میراند و توسعه را توجیه میکند – حتی اگر هزینههای این توسعه مستقیماً مأموریت اعلامشده ایدئولوژی را نقض کند.

برای قدرتهای استعماری اروپا، این مسیحیت و وعده نجات روحها در حین استخراج منابع بود. برای امپراتوری هوش مصنوعی امروز، این هوش مصنوعی عمومی (AGI) است برای “منفعت همه بشریت”. و OpenAI مبلغ اصلی آن است، که شور و شوق را در سراسر صنعت گسترش میدهد به گونهای که نحوه ساخت هوش مصنوعی را بازتعریف کرده است.

کارن هائو، روزنامهنگار و نویسنده پرفروش کتاب “امپراتوری هوش مصنوعی”، در یکی از قسمتهای اخیر Equity به خبرنگار گفت: “من با افرادی مصاحبه میکردم که صدایشان از شدت اعتقادشان به AGI میلرزید.”

هائو در کتاب خود، صنعت هوش مصنوعی به طور کلی و OpenAI به طور خاص را به یک امپراتوری تشبیه میکند.

هائو گفت: “تنها راه برای درک واقعی دامنه و مقیاس رفتار OpenAI… این است که تشخیص دهیم آنها در حال حاضر قدرتمندتر از تقریباً هر دولت-ملت دیگری در جهان شدهاند و مقدار فوقالعادهای از قدرت نه تنها اقتصادی، بلکه قدرت سیاسی را نیز تثبیت کردهاند.” “آنها در حال تغییر شکل زمین هستند. آنها در حال بازسازی ژئوپلیتیک ما، تمام زندگی ما هستند. بنابراین شما فقط میتوانید آن را به عنوان یک امپراتوری توصیف کنید.”

OpenAI، هوش مصنوعی عمومی (AGI) را به عنوان “یک سیستم بسیار خودمختار که در اکثر کارهای با ارزش اقتصادی از انسانها بهتر عمل میکند” توصیف کرده است، سیستمی که به نوعی “با افزایش فراوانی، تقویت اقتصاد و کمک به کشف دانش علمی جدید که محدودیتهای امکان را تغییر میدهد، باعث ارتقای بشریت میشود.”

این وعدههای مبهم، رشد نمایی صنعت را تغذیه کرده است – تقاضای عظیم آن برای منابع، اقیانوسهای دادههای خراشیده شده، شبکههای انرژی تحت فشار و تمایل به انتشار سیستمهای آزمایش نشده در جهان. همه اینها در خدمت آیندهای است که بسیاری از کارشناسان میگویند ممکن است هرگز از راه نرسد.

هائو میگوید این مسیر اجتنابناپذیر نبوده است و مقیاسبندی تنها راه برای دستیابی به پیشرفتهای بیشتر در هوش مصنوعی نیست.

او گفت: “شما همچنین میتوانید تکنیکهای جدیدی در الگوریتمها توسعه دهید. شما میتوانید الگوریتمهای موجود را بهبود بخشید تا میزان داده و محاسباتی را که نیاز به استفاده دارند کاهش دهید.”

اما این تاکتیک به معنای قربانی کردن سرعت بود.

هائو گفت: “وقتی شما تلاش برای ساختن AGI سودمند را به عنوان تلاشی تعریف میکنید که در آن برنده همه چیز را میبرد – که این همان کاری است که OpenAI انجام داد – پس مهمترین چیز سرعت بالاتر از هر چیز دیگری است.” “سرعت بالاتر از کارایی، سرعت بالاتر از ایمنی، سرعت بالاتر از تحقیقات اکتشافی.”

به گفته او، برای OpenAI، بهترین راه برای تضمین سرعت این بود که تکنیکهای موجود را بگیرند و “فقط کار ارزان از نظر فکری را انجام دهند، که عبارت است از پمپاژ دادههای بیشتر، ابررایانههای بیشتر، به این تکنیکهای موجود.”

OpenAI صحنه را آماده کرد و شرکتهای فناوری دیگر به جای عقب افتادن، تصمیم گرفتند همسو شوند.

هائو گفت: “و از آنجا که صنعت هوش مصنوعی با موفقیت اکثر محققان برتر هوش مصنوعی در جهان را جذب کرده است و این محققان دیگر در دانشگاهها حضور ندارند، اکنون یک رشته کامل وجود دارد که توسط دستور کار این شرکتها شکل میگیرد، نه توسط اکتشافات علمی واقعی.”

هزینهها سرسامآور بوده و خواهد بود. هفته گذشته، OpenAI اعلام کرد که انتظار دارد تا سال ۱۴۰۸ (2029) ۱۱۵ میلیارد دلار پول نقد مصرف کند. متا در تیر ماه اعلام کرد که امسال تا ۷۲ میلیارد دلار برای ساخت زیرساختهای هوش مصنوعی هزینه خواهد کرد. گوگل انتظار دارد تا سال ۱۴۰۴ (2025) تا ۸۵ میلیارد دلار در هزینههای سرمایهای هزینه کند، که بیشتر آن صرف گسترش زیرساختهای هوش مصنوعی و ابری خواهد شد.

در همین حال، اهداف همچنان در حال تغییر هستند و والاترین “مزایای برای بشریت” هنوز محقق نشدهاند، حتی با وجود اینکه آسیبها در حال افزایش هستند. آسیبهایی مانند از دست دادن شغل، تمرکز ثروت و چتباتهای هوش مصنوعی که به توهمات و روانپریشی دامن میزنند. هائو در کتاب خود همچنین کارگرانی را در کشورهای در حال توسعه مانند کنیا و ونزوئلا مستند میکند که در معرض محتوای آزاردهنده، از جمله محتوای سوء استفاده جنسی از کودکان، قرار گرفتند و دستمزدهای بسیار پایینی – حدود ۱ تا ۲ دلار در ساعت – در نقشهایی مانند تعدیل محتوا و برچسبگذاری داده دریافت میکردند.

هائو گفت این یک معاوضه نادرست است که پیشرفت هوش مصنوعی را در برابر آسیبهای کنونی قرار دهیم، به ویژه زمانی که اشکال دیگر هوش مصنوعی مزایای واقعی ارائه میدهند.

او به AlphaFold گوگل DeepMind اشاره کرد که برنده جایزه نوبل شده است، که بر اساس دادههای توالی اسیدهای آمینه و ساختارهای پیچیده تاشدگی پروتئین آموزش داده شده است و اکنون میتواند ساختار سه بعدی پروتئینها را از اسیدهای آمینه آنها به طور دقیق پیشبینی کند – که برای کشف دارو و درک بیماری بسیار مفید است.

هائو گفت: “اینها انواع سیستمهای هوش مصنوعی هستند که ما به آنها نیاز داریم. AlphaFold باعث ایجاد بحرانهای سلامت روان در افراد نمیشود. AlphaFold منجر به آسیبهای زیستمحیطی عظیم نمیشود… زیرا بر روی زیرساختهای بسیار کمتری آموزش داده شده است. این سیستم باعث ایجاد آسیبهای تعدیل محتوا نمیشود زیرا [مجموعه دادهها] تمام آشغالهای سمی را که هنگام خراش دادن اینترنت جمع کردهاید، ندارند.”

در کنار تعهد شبهمذهبی به AGI، روایتی در مورد اهمیت مسابقه برای شکست دادن چین در مسابقه هوش مصنوعی وجود داشته است، به طوری که سیلیکون ولی میتواند تأثیر لیبرالی بر جهان داشته باشد.

هائو گفت: “به معنای واقعی کلمه، عکس این اتفاق افتاده است. شکاف بین ایالات متحده و چین همچنان در حال کاهش است و سیلیکون ولی تأثیر غیرلیبرالی بر جهان داشته است… و تنها بازیگری که از این وضعیت بدون آسیب بیرون آمده است، میتوان گفت خود سیلیکون ولی است.”

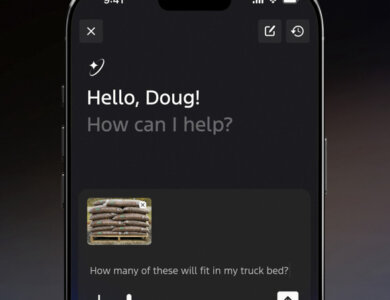

البته، بسیاری استدلال خواهند کرد که OpenAI و دیگر شرکتهای هوش مصنوعی با انتشار ChatGPT و دیگر مدلهای زبانی بزرگ، که وعده دستاوردهای بزرگی در بهرهوری با خودکارسازی وظایفی مانند کدنویسی، نوشتن، تحقیق، پشتیبانی مشتری و دیگر وظایف مرتبط با دانش میدهند، به بشریت سود رساندهاند.

اما نحوه ساختار OpenAI – بخشی غیرانتفاعی، بخشی انتفاعی – نحوه تعریف و اندازهگیری تأثیر آن بر بشریت را پیچیده میکند. و این موضوع با اخباری که این هفته منتشر شد مبنی بر اینکه OpenAI به توافقی با مایکروسافت رسیده است که آن را به عرضه عمومی سهام نزدیکتر میکند، پیچیدهتر میشود.

دو محقق ایمنی سابق OpenAI به خبرنگار گفتند که میترسند این آزمایشگاه هوش مصنوعی شروع به اشتباه گرفتن مأموریتهای انتفاعی و غیرانتفاعی خود کرده باشد – به این دلیل که مردم از استفاده از ChatGPT و سایر محصولات ساخته شده بر اساس LLMها لذت میبرند، این امر تیکِ سودمند بودن برای بشریت را میزند.

هائو این نگرانیها را تکرار کرد و خطرات غرق شدن در مأموریتی را توصیف کرد که واقعیت را نادیده میگیرد.

هائو گفت: “حتی با وجود اینکه شواهد انباشته میشوند که آنچه آنها میسازند در واقع به مقادیر قابل توجهی از افراد آسیب میرساند، مأموریت همچنان همه اینها را پنهان میکند. چیزی واقعاً خطرناک و تاریک در این مورد وجود دارد، اینکه آنقدر در یک نظام اعتقادی که خودتان ساختهاید غرق شوید که ارتباط خود را با واقعیت از دست بدهید.”

منبع : techcrunch.com