معماری قدرتمند روبین: رونمایی تراشه جدید توسط انویدیا

“`html

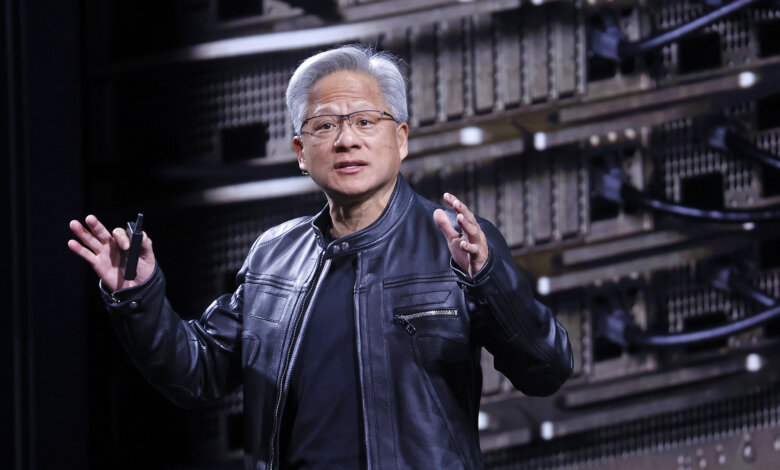

امروز در نمایشگاه لوازم الکترونیک مصرفی، مدیرعامل انویدیا، جنسن هوانگ، به طور رسمی معماری محاسباتی جدید این شرکت به نام روبین را معرفی کرد. او این فناوری را پیشرفتهترین سختافزار هوش مصنوعی توصیف نمود. این معماری جدید در حال حاضر در مرحله تولید قرار دارد و انتظار میرود در نیمه دوم سال جاری میلادی، تولید آن بیشتر افزایش یابد.

هوانگ به حاضرین گفت: «ویرا روبین برای پاسخ به چالش اساسی ما طراحی شده است: مقدار محاسبات لازم برای هوش مصنوعی به سرعت در حال افزایش است. امروز میتوانم به شما بگویم که ویرا روبین به طور کامل وارد مرحله تولید شده است.»

معماری روبین، که اولین بار در سال ۱۴۰۳ معرفی شد، جدیدترین نتیجه چرخه توسعه بیوقفه سختافزاری انویدیا است؛ چرخهای که انویدیا را به باارزشترین شرکت جهان تبدیل کرده است. معماری روبین جایگزین معماری بلکول خواهد شد که پیشتر جایگزین معماریهای هاپر و لاولیس بود.

تراشههای روبین در حال حاضر قرار است توسط تقریباً تمامی ارائهدهندگان اصلی سرویسهای ابری مورد استفاده قرار گیرند؛ از جمله مشارکتهای شاخص انویدیا با شرکتهایی مانند Anthropic، OpenAI و سرویس وب آمازون. سیستمهای روبین همچنین در ابررایانه Blue Lion شرکت HPE و ابررایانه آتی Doudna در آزمایشگاه ملی لارنس برکلی نیز به کار گرفته خواهند شد.

نام معماری روبین از ستارهشناس ویرا فلورنس کوپر روبین گرفته شده است. این معماری شامل شش تراشه جداگانه است که برای همکاری با یکدیگر طراحی شدهاند. پردازنده گرافیکی روبین در مرکز این معماری قرار دارد، اما این معماری همچنین به گلوگاههای روبهرشد ذخیرهسازی و اتصال بینتراشهای نیز با بهبودهای جدید در سیستمهای Bluefield و NVLink پاسخ میدهد. همچنین یک پردازنده جدید به نام Vera CPU که برای پردازش استدلالهای عاملمحور طراحی شده نیز بخشی از این معماری است.

دیون هریس، مدیر ارشد راهکارهای زیرساخت هوش مصنوعی انویدیا، در توضیح مزایای سیستم ذخیرهسازی جدید، به نیازهای روزافزون حافظه کش در سیستمهای هوش مصنوعی اشاره کرد.

هریس به خبرنگاران گفت: «وقتی شما شروع به فعال کردن نوع جدیدی از گردش کارها، مانند هوش مصنوعی عاملمحور یا وظایف بلندمدت میکنید، فشار زیادی روی کش KV وارد میشود.» او به نوعی سیستم حافظه اشاره کرد که مدلهای هوش مصنوعی برای فشردهسازی ورودیها از آن استفاده میکنند. «به همین دلیل، ما یک لایه جدید ذخیرهسازی معرفی کردهایم که به صورت خارجی به دستگاه محاسباتی متصل میشود و این امکان را میدهد که حجم ذخیرهسازی خود را بسیار کارآمدتر افزایش دهید.»

همانطور که انتظار میرفت، معماری جدید پیشرفتی چشمگیر در سرعت و بازده انرژی را نیز به دنبال دارد. بر اساس آزمایشهای انویدیا، معماری روبین در وظایف آموزش مدل سه و نیم برابر سریعتر از نسل قبلی بلکول عمل میکند و در انجام استنتاج، پنج برابر سریعتر است و به رکوردهایی تا ۵۰ پتافلاپس میرسد. این پلتفرم قابلیت پشتیبانی از هشت برابر محاسبه استنتاج بیشتر به ازای هر وات را نیز داراست.

قابلیتهای جدید روبین در حالی ارائه میشوند که رقابت شدیدی برای ساخت زیرساختهای هوش مصنوعی وجود دارد و هم آزمایشگاههای هوش مصنوعی و هم ارائهدهندگان سرویسهای ابری به دنبال تهیه تراشههای انویدیا و تأمین تأسیسات مورد نیاز برای آنها هستند. در تماس درآمدی ماه مهر ۱۴۰۴، هوانگ برآورد کرد که طی پنج سال آینده، بین ۳ تا ۴ تریلیون دلار در زیرساختهای هوش مصنوعی سرمایهگذاری خواهد شد.

“`