چرا قانون جدید ایمنی هوش مصنوعی در کالیفرنیا موفق شد در حالی که SB 1047 شکست خورد؟

کالیفرنیا به عنوان اولین ایالت در تاریخ، الزام به شفافیت ایمنی هوش مصنوعی را از بزرگترین آزمایشگاههای این صنعت خواستار شد. گاورنر نیوزوم این هفته قانون SB 53 را امضا کرد که شرکتهای بزرگ هوش مصنوعی مانند OpenAI و Anthropic را ملزم میکند پروتکلهای ایمنی خود را افشا کرده و به آنها پایبند باشند. این تصمیم در حال حاضر بحثهایی را برانگیخته است که آیا سایر ایالتها نیز از این روند پیروی خواهند کرد یا خیر.

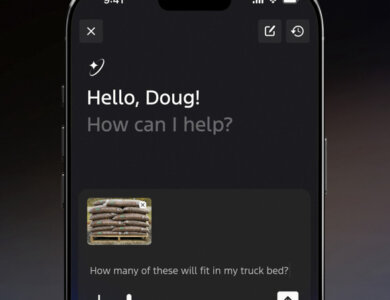

آدام بیلن، معاون سیاستگذاری عمومی در Encode AI، به اکوئیتی پیوست تا توضیح دهد که قانون جدید شفافیت هوش مصنوعی کالیفرنیا واقعاً به چه معناست – از حمایت از افشاگران گرفته تا الزامات گزارشدهی حوادث ایمنی. او همچنین توضیح میدهد که چرا SB 53 در جایی که SB 1047 شکست خورد، موفق شد، “شفافیت بدون مسئولیت” در عمل چگونه به نظر میرسد، و چه موارد دیگری هنوز روی میز گاورنر نیوزوم قرار دارد، از جمله قوانین مربوط به رباتهای گفتگو همراه هوش مصنوعی.

اکوئیتی پادکست اصلی خبرنگار است که توسط ترزا لوکونسولو تهیه میشود.